| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 | 31 |

- directx

- Direct12

- 그리디알고리즘

- 운영체제

- 렌더링 파이프라인

- 그리디 알고리즘

- 스케줄링

- I/O장치

- 알고리즘

- 동적계획법

- 쓰레드

- 백준

- 멀티프로세서

- DirectX 12

- DirectX12

- 프로그래머스

- 타입 객체

- 병행성

- 디자인패턴

- 멀티쓰레드

- 병행성 관련 오류

- 컨디션 변수

- 락

- 다이나믹프로그래밍

- codility

- 파일시스템 구현

- 영속성

- 다이나믹 프로그래밍

- OS

- 자료구조

- Today

- Total

기록공간

2-5장. 멀티프로세서 스케줄링 본문

고사양 컴퓨터에만 존재했던 멀티프로세서(Multiprocessor) 시스템은 일반적이 되었으며, 데스크톱 컴퓨터, 노트북, 심지어 모바일 장치에도 사용되고 있다. 여러 개의 CPU 코어가 하나의 칩에 내장된 멀티코어(Multicore) 프로세서가 대중화의 근본 원인이다. 싱글코어 CPU의 성능 개선이 한계에 봉착하면서 멀티코어 기술이 각광을 받게 되었다. 우리는 다수의 CPU를 사용할 수 있게 되었다.

이로 인해 운영체제가 새롭게 직면한 문제는 멀티프로세서 스케줄링이다. 지금까지 다뤘던 많은 원칙들은 단일 CPU를 전재로 하고 있었다. 그러면 여러 CPU에서 동작하도록 어떻게 확장할 수 있을까? 해결해야 하는 새로운 문제는 무엇이 있을까?

배경 : 멀티프로세서 구조

멀티프로세서 스케줄링에 대한 새로운 문제점을 이해하기 위해서는 단일 CPU 하드웨어와 멀티 CPU 하드웨어의 근본적인 차이에 대한 이해가 필요하다. 다수의 프로세서간에 데이터 공유, 그리고 하드웨어 캐시의 사용 방식에서 근본적인 차이가 발생한다.

단일 CPU 시스템에는 하드웨어 캐시 계층이 존재한다. 이 캐시는 프로그램을 빠르게 실행하기 위해 존재한다. 캐시는 메인 메모리에서 자주 사용되는 데이터의 복사본을 저장하는 작고 빠른 메모리이다. 메인 메모리는 모든 데이터를 저장하지만 느리다. 자주 접근되는 데이터를 캐시에 임시로 가져다 둠으로써 시스템은 크고 느린 메모리를 빠른 메모리처럼 보이게 한다.

메인 메모리에서 데이터를 CPU로 가져올때 캐시는 다시 사용될 것이라 생각하는 데이터를 캐시에 저장해 놓고 나중에 또 데이터를 가지고 올때 캐시에 그 데이터가 존재하는지 검사한다. 캐시에 존재하기 때문에 데이터는 훨씬 빨리 접근되고 프로그램은 빨리 실행된다.

캐시는 지역성(Locality)에 기반한다. 지역성에는 시간 지역성(Temporal locality)과 공간 지역성(Spatial locality)의 두 종류가 있다.

시간 지역성의 기본 아이디어는 데이터가 한 번 접근되면 가까운 미래에 다시 접근되기 쉽다는 것이다. 루프에서 여러 번 반복해서 접근되는 변수 또는 명령어 자체를 상상해 보라. 공간 지역성의 기본 아이디어는 프로그램이 주소 x의 데이터를 접근하면 x 주변의 데이터가 접근되기 쉽다는 것이다. 전체 배열을 차례대로 접근하는 프로그램 또는 순차적으로 실행되는 명령어들을 생각해 보자. 이런 유형의 지역성은 많은 프로그램에서 관측된다. 하드웨어 시스템은 캐시에 어떤 데이터를 저장할지 비교적 정확하게 추측을 할 수 있고, 캐시는 잘 작동된다.

이제 까다로운 부분을 살펴보겠다. 만약 하나의 시스템에 여러 프로세서가 존재하고 하나의 공유 메인 메모리가 있을 때 어떤 일이 일어날까?

위 그림을 잘 살펴보자. CPU 0에서 실행 중인 프로그램이 주소 1를(D값을) 읽는다. 데이터가 CPU 0 캐시에 존재하지 않기 때문에 시스템은 메인 메모리로부터 데이터를 가져오고 값 D를 얻는다. 그런 후 프로그램은 주소 1의 값을 변경한다. 변경은 캐시에 존재하는 값만 D'로 갱신한다. 메모리에 데이터를 쓰는 것은 시간이 오래 걸리므로 메인 메모리에 기록하는 것은 보통 나중에 한다. 운영체제가 프로그램의 실행을 중단하고 CPU 1로 이동하기로 결정한다고 가정하자. 프로그램은 주소 1의 값을 다시 읽는다. CPU 1의 캐시에는 그러한 데이터가 존재하지 않기 때문에 시스템은 메인 메모리에서 데이터를 가져온다. 이때 D'가 아니라 D를 가져온다.

이 문제를 캐시 일관성 문제(Cache coherence)라고 부른다. 여기서는 모든 차이점을 생략하고 주요 쟁점에 대해서만 언급한다.

기본적인 해결책은 해드웨어에 의해 제공된다. 하드웨어는 메모리 주소를 계속 감시하고, 항상 "제대로"된 상황만 발생토록 시스템을 관리한다. 특히, 여러 개의 프로세스들이 하나의 메모리에 갱신할 때에는 항상 공유되도록 한다.

버스 기반 시스템에서는 버스 스누핑(Bus snooping)이라는 오래된 기법을 사용한다. 캐시는 자신과 메모리를 연결하는 버스의 통신 상황을 계속 모니터링한다. 캐시 데이터의 대한 변경이 발생하면, 자신의 복사본을 무효화(Invalidate) 시키거나 (자신의 캐시에서 삭제) 갱신(새로운 값을 캐시에 기록)한다.

동기화를 잊지 마시오

일관성 유지에 대한 모든 일을 캐시가 담당한다면, 프로그램 또는 운영체제 자신은 공유 데이터를 접근할 때 걱정할 필요가 있을까? 불행하게도 대답은 Yes이다.

CPU들이 동일한 데이터 또는 구조체에 접근할 때(갱신), 올바른 연산 결과를 보장하기 위해 락과 같은 상호 배제를 보장하는 동기화 기법이 많이 사용된다. 락 프리(Lock-free) 데이터 구조 등의 다른 방식은 복잡할 뿐 아니라 특별한 경우에만 사용 된다. 이것은 병행성에서 자세하게 다룰 예정이다.

예를 들어, 여러 CPU가 동시에 사용하는 공유 큐(Queue)가 있다고 가정하자. 캐시의 일관성을 보장하는 프로토콜이 존재한다 하더라도 락이 없이는 항목의 추가나 삭제가 제대로 동작하지 않을 것이다. 구조체를 원자적(Atomic)으로 갱신하기 위해서는 락이 필요하다.

연결 리스트에서 원소 하나를 삭제하는 코드를 생각해보자. 코드는 위 그림과 같다. 두 CPU의 스레드가 동시에 이 루틴으로 진입한다고 가정하자. 스레드 1이 첫 번째 행을 실행하면 head의 현재 값을 tmp에 저장한다. 그런 후 스레드 2가 첫 번째 행을 실행하면 역시 head의 같은 값을 tmp에 저장한다. tmp는 스택에 할당된다. 각 스레드는 자신만의 스택을 갖고 있다. 각 스레드는 동일한 헤드 원소를 제거하려고 한다. 제대로 된 상황에서는 각 스레드는 리스트의 첫 번째 원소를 한 번씩 제거해야 한다. 이러한 상황이 모든 문제를 야기한다. (4행의 헤드 원소를 두 번 삭제하고 같은 데이터의 값을 두 번 반환하는 등)

물론 해결책은 위 그림처럼 락(Lock)을 사용하여 올바르게 동작하도록 만드는 것이다. 간단한 mutex를 할당하고 루틴의 시작에서 lock(&m) 마지막에 unlock(&m)을 추가하면 문제를 해결할 수 있다. 병행성에서 살펴 보겠지만 이 방식이 문제가 없는 것은 아니다. 특히, 성능 측면에서 문제가 있다. CPU의 개수가 증가할수록 동기화된 자료 구조에 접근하는 연산은 매우 느리게 된다.

마지막 문제점 : 캐시 친화성

멀티프로세서 캐시 스케줄러에서의 마지막 문제점은 캐시 친화성(Cache affinity)이다. 개념은 간단하다. CPU에서 실행될 때 프로세스는 해당 CPU 캐시와 TLB에 상당한 양의 상태 정보를 올려 놓게 된다. 다음 번에 프로세스가 실행될 때 동일한 CPU에서 실행되는 것이 유리하다. 해당 CPU 캐시에 일부 정보가 이미 존재하고 있기 때문에 더 빨리 실행될 것이기 때문이다.

반면 프로세스가 매번 다른 CPU에서 실행되면 실행할때마다 필요한 정보를 캐시에 다시 탑재해야만 하기 때문에 프로세스의 성능은 더 나빠질 것이다. 하드웨어의 캐시 일관성 프로토콜 덕분에 다른 CPU에서 실행되더라도 프로그램이 제대로 실행될 것이다. 멀티프로세서 스케줄러는 스케줄링 결정을 내릴때 캐시 친화성을 고려해야 한다. 가능한 한 프로세스를 동일한 CPU에 실행하려고 노력하는 방향으로 결정해야 한다.

단일 큐 스케줄링

이제 멀티프로세서 시스템의 스케줄러 개발 방법에 대해 논의해보자. 가장 기본적인 방식은 단일 프로세서 스케줄리의 기본 프레임워크를 그대로 사용하는 것이다. 이러한 방식을 단일 큐 멀티프로세서 스케줄링(Single Queue Multiprocessor Scheduling, SQMS)이라고 부른다. 이 방식의 장점은 단순함이다. 기존 정책을 다수 CPU에서 동작하도록 하는 데는 많은 변경이 필요치 않다. 예를 들어, CPU가 2개라면 실행할 작업 두 개 를 선택한다.

그러나 SQMS는 명백한 단점이 있다. 첫 번째 문제는 확장성(Scalability) 결여이다. 스케줄러가 다수의 CPU에서 제대로 동작하게 하기 위해 코드에 일정 형태의 락을 삽입한다. 락은 SQMS 코드가 단일 큐를 접근할 때 (실행시킬 다음 작업을 찾을 때) 올바른 결과를 나오도록 한다.

불행히도 락은 성능을 크게 저하시킬 수 있고, 시스템의 CPU 개수가 증가할수록 더욱 그렇다. 단일 락에 대한 경쟁이 증가할수록 시스템은 락에 점점 더 많은 시간을 소모하게 되고 실제 필요한 일에 쓰는 시간은 줄어들게 된다.

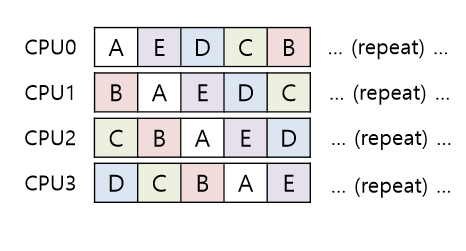

두 번째 문제는 캐시 친화성이다. 예를 들어, 실행할 5개의 작업이 있고 (A, B, C, D, E) 4개의 프로세서가 있다고 가정하자. 스케줄링 큐는 다음과 같은 모양일 것이다.

시간이 흐르면서 각 작업은 주어진 타임 슬라이스 동안 실행되고, 다음 작업이 선택되었다고 가정하자. 작업 스케줄은 다음과 같을 것이다.

각 CPU는 공유 큐에서 다음 작업을 선택하기 때문에 각 작업은 CPU를 옮겨 다니게 된다. 캐시 친화성 관점에서 보면 잘못된 선택을 하는 것이다.

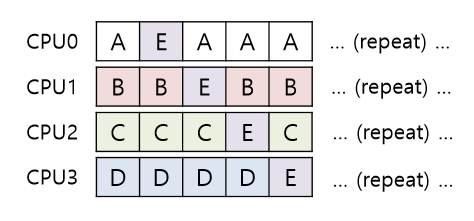

이 문제의 해결을 위해 대부분의 SQMS 스케줄러는 가능한 한 프로세스가 동일한 CPU에서 재실행될 수 있도록 시도한다. 구체적으로, 특정 작업들에 대해서 캐시 친화성을 고려하여 스케줄링하고 다른 작업들은 오버헤드를 균등하게 하기 위해 여러 군데로 분산시키는 정책을 사용한다. 예를 들어 다음과 같은 동일한 5개의 작업에 대해 생각해보자.

이 배열에서 A부터 D까지의 작업은 각각 자신의 프로세서에서 실행된다. 오직 E만이 하나의 프로세서에서 다른 프로세서로 이동한다. 그렇게 함으로써 대부분의 작업에게 친화성을 보존하고 있다. 다음에는 다른 작업을 이동시켜서 일종의 친화성에 대한 형평성도 추구할 수 있다. 그러나 이러한 기법은 구현이 복잡해질 수 있다.

이렇게 SQMS 방식은 기존의 단일 CPU 스케줄러가 있다면 하나의 큐밖에 없으므로 구현이 간단하지만, 동기화 오버헤드 때문에 확장성이 좋지 않고 캐시 친화성에 문제가 있다.

멀티 큐 스케줄링

단일 큐 스케줄러로 인한 문제 때문에 일부 시스템은 CPU마다 큐를 하나씩 둔다. 이 방식을 멀티 큐 멀티프로세서 스케줄링(Multi-queue multiprocessor scheduling, MQMS)이라고 부른다.

MQMS에서 기본적인 스케줄링 프레임워크는 여러 개의 스케줄링 큐로 구성된다. 각 큐는 아마도 라운드 로빈 같은 특정 스케줄링 규칙을 따를 것이고 물론 어떤 스케줄링 기법도 사용 가능하다. 작업이 시스템에 들어가면 하나의 스케줄링 큐에 배치된다. 배치될 큐의 결정은 적당한 방법을 따른다. (무작위로 할 수도 있고 다른 큐보다 작은 수의 작업이 있는 큐로 배치될 수도 있다) 그 후에는 각각이 독립적으로 스케줄 되기 때문에 단일 큐 방식에서 보았던 정보의 공유 및 동기화 문제를 피할 수 있다.

예를 들어, 2개의 CPU와 A, B, C, D 네 개의 작업이 시스템에서 존재한다고 가정하자. CPU는 각자 하나씩의 스케줄링 큐를 가지고 있으므로 운영체제는 각 작업을 배치할 큐를 결정해야 한다. 다음과 같은 결정을 내렸다고 하자.

큐 스케줄링 정책에 따라 각 CPU는 현재 2개씩의 작업을 가지고 있다. 예를 들어 라운드 로빈의 경우 다음과 같은 스케줄이 생성될 수 있다.

MQMS가 SQMS에 비해 가지는 명확한 이점은 확장성이 좋다는 것이다. CPU 개수가 증가할수록, 큐의 개수도 증가하므로 락과 캐시 경합(Cache contention)은 더 이상 문제가 되지 않는다.또한, MQMS는 본질적으로 캐시 친화적이다. 작업이 같은 CPU에서 계속 실행되기 때문에 캐시에 저장된 내용을 재사용하는 이점을 얻게 된다.

하지만 문제점도 존재하는데, 멀티 큐 기반 방식의 근본적인 문제는 워크로드 불균형(Workload imbalance)이다. 앞의 예와 동일한 설정을 가정하자. 그러나 그 중 하나(C)가 종료 되었다고 하자. 이제 다음과 같은 스케줄링 큐를 가진다.

그림에서 알 수 있듯이, A가 B와 D보다 2배의 CPU를 차지하고 이는 원하는 결과가 아니다. 설상가상으로 A와 C가 모두 종료하여 B와 D만 남게 되었다고 가정하자. 스케줄링 큐는 다음과 같을 것이다.

결과 CPU 0은 유휴 상태가 된다! 그래서 CPU 사용 타임라인 다음 모양이 된다.

그렇다면 MQMS 스케줄러는 무엇을 해야 할까? 어떻게 하면 이 오버헤드 불균형 문제를 극복할 수 있을까?

이 질문 대한 당연한 답은 작업을 이리저리로 이동시키는 것이다. 우리는 이 기술을 이주(Migration)라고 부른다. 작업을 한 CPU에서 다른 CPU로 이주시킴으로써 워크로드 균형을 달성한다.

좀 더 명확하게 하기 위하여 몇 가지 예를 보도록 하자. 하나의 CPU는 유휴 상태이고 다른 CPU는 몇몇 작업을 가지고 있다고 하자.

이 경우 어떻게 이주시켜야 하는지 이해하기 쉽다. 운영체제는 B 또는 D 중 하나를 CPU 0으로 이동시킨다. 이 한 번의 작업 이주로 워크로드 균형을 이루게 된다.

좀 더 까다로운 경우는 그 이전 예에서 발생한다. A는 혼자 CPU 0에 있었고 B와 D는 CPU 1에서 번갈아 실행되고 있었다.

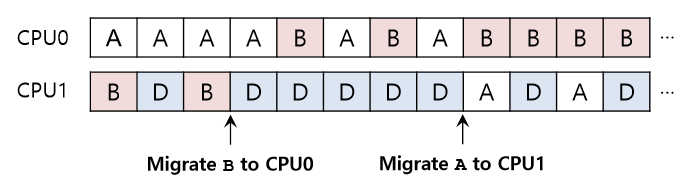

이 경우 한 번의 이주만으로는 문제가 해결되지 않는다. 무엇을 해야 할까? 대답은 작업들을 지속적으로 이주시키는 것이다. 한 가지 가능한 해결책은 다음 타임라인에서 볼 수 있는 것처럼 작업을 계속해서 이주 시키는 것이다.

처음에 A는 CPU 0에 혼자 있고 B와 D는 CPU 1에서 번갈아 실행되고 있다. 몇 번의 타임슬라이스 후 B는 CPU 0으로 이주하여 A와 경쟁한다. 그 동안 D는 CPU 1에서 몇 개의 타임슬라이스 동안 혼자 실행된다. 따라서 워크로드 균형이 맞게 된다.

물론 가능한 많은 다른 이주 패턴이 존재한다. 그러나 지금의 더 까다로운 부분인 이주의 필요 여부를 어떻게 결정할까?

기본적인 접근 방식은 바로 작업 훔치기(Work stealing)이라는 기술이다. 작업 훔치기에서는 작업의 개수가 낮은 큐가 가끔 다른 큐에 훨씬 많은 수의 작업이 있는지를 검사한다. 대상 큐가 소스 큐보다 더 가득 차 있다면 워크로드 균형을 맞추기 위해 소스는 대상에서 하나 이상의 작업을 가져온다.

물론 이러한 방식에는 자연스러운 문제가 있다. 큐를 너무 자주 검사하게 되면 높은 오버헤드로 확장성에 문제가 생기게 된다. 확장성은 멀티 큐 스케줄링의 가장 중요한 목적이다. 반면 다른 큐를 자주 검사하지 않으면 심각한 워크로드 불균형을 초래할 가능성이 있다. 시스템 정책 설계에 있어서 절충선을 찾아내는 것이 중요하다.

동시 실행

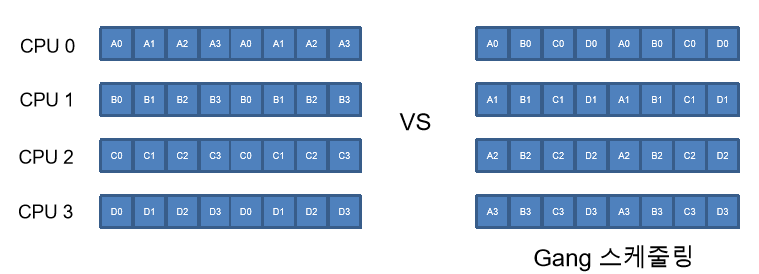

작업을 여러 개의 스레드로 나누어 여러 개의 CPU에서 동시에 스케줄링 하여 실행하는 방법도 있다. 이것을 Gang 스케줄링 이라고 한다. 여러 개의 스레드를 갖는 프로세스가 여러 개 실행될 경우 다음 그림과 같다. (4개의 프로세스(A, B, C, D)와 프로세스당 4개의 스레드(0, 1, 2, 3))

Gang 스케줄링의 장점은 빠른 동기화가 된다는 것이지만, 단점은 캐시 친화성이 약하다는 것이다.

Linux 멀티프로세서 스케줄러

세 가지 스케줄러가 등장했다. O(1) 스케줄러, Completely Fair Scheduler(CFS) 및 BFS가 바로 그것이다.

O(1)과 CFS는 멀티 큐를 BFS는 단일 큐를 사용하기 때문에 두 방식 모두 실제 시스템에서 성공적으로 사용할 수 있다는 것을 보이고 있다. 물론, 이 스케줄러를 구분하는 다른 많은 분류 기준들이 존재한다.

예를 들어, O(1) 스케줄러는 우선순위 기반 스케줄러로서 (MLFQ와 유사) 프로세스의 우선순위를 시간에 따라 변경하여 우선순위가 가장 높은 작업을 선택하여 다양한 목적을 만족시킨다. 특히, 상호작용을 가장 우선시 한다.

반면에 CFS는 여러 개의 큐를 사용한 결정론적 비례배분 방식이다.

BFS는 셋 중에서 유일하게 단일 큐 방식이며 또한 비례배분 방식이다. 그러나 Earliest Eligible Virtual Deadline First(EEVDF)라고 알려진 더 복잡한 방식에 기반을 둔다.

'OS' 카테고리의 다른 글

| 2-7장. 메모리 관리 API (0) | 2020.03.04 |

|---|---|

| 2-6장. 주소 공간의 개념 (0) | 2020.03.02 |

| 2-4장. 스케줄링 : 멀티 레벨 피드백 큐(MLFQ) (2) | 2020.02.25 |

| 2-3장. 스케줄링 : 개요 (0) | 2020.02.21 |

| 2-2장. Mechanism : 제한적 직접 실행 원리 (0) | 2020.02.19 |